Big Data, a predictive maintenance

Katgoria: BUSINESS INTELLIGENCE / Utworzono: 27 wrzesień 2017

Wraz z pojawieniem się nowych możliwości, które rozpowszechniły kocepcję obliczeń rozproszonych, koszt związany z gromadzeniem danych znacznie się zmniejszył. Wielu przedsiębiorców zaczęło przechowywać dane, które nie były dotychczas wykorzystywane produkcyjnie, z nadzieją, iż drzemiący w nich potencjał pozwoli im w przyszłości uzyskać przewagę konkurencyjną. W dobie Internet of Things, ilość generowanych danych przez otaczające nas urządzenia jest ogromna. Szybko okazało się, że skoro przechowywanie danych nie wiąże się z dużymi kosztami, jedynym ograniczeniem jest kreatywność analityków.

Analityka w klasycznym wydaniu polega na znalezieniu odpowiedzi na wcześniej postawione i znane już pytania. W świecie Big Data sprawa wygląda nieco inaczej. Wyszukuje się nowych, nieodkrytych dotąd problemów i miejsc, w których można poprawić, usprawnić działalność przedsiębiorstwa, wpłynąć na działalność operacyjną i dzięki temu przyczynić się do poprawy wyniku finansowego. Przedstawione podejście wymaga dokładnego poznania i zrozumienia danych oraz otoczenia gospodarczego.

Jedną z metodologii, która pozwala na ustandaryzowanie procesów związanych z eksploracją i analizą danych jest CRISP-DM (Cross Industry Standard Process for Data Mining). Zakłada on, że każdy projekt z dziedziny analizy danych powinien składać się z następujących faz:

Jedną z metodologii, która pozwala na ustandaryzowanie procesów związanych z eksploracją i analizą danych jest CRISP-DM (Cross Industry Standard Process for Data Mining). Zakłada on, że każdy projekt z dziedziny analizy danych powinien składać się z następujących faz:

- Zrozumienie uwarunkowań biznesowych.

- Zrozumienie danych.

- Przygotowanie danych.

- Modelowanie.

- Ewaluacja.

- Wdrożenie.

Pierwszy punkt pozwala zrozumieć profil, charakter, pozycję rynkową przedsiębiorstwa, jej codzienną działalność i problemy, z którymi się mierzy. Istotne jest również zrozumienie danych, ponieważ to one są źródłem wszelkich informacji. Często jakość danych pozostawia wiele do życzenia, stąd lepsze ich zrozumienie jest niezbędne, by mogły zostać właściwie oczyszczone w następnym kroku. Szacuje się, że przygotowanie danych jest najbardziej czasochłonnym krokiem w procesach analitycznych. Modelowanie i ewaluacja polegają na budowaniu modeli i wybraniu spośród nich tego, o największej zdolności predykcyjnej. Ostatnim krokiem jest produkcyjne wdrożenie, ale cykl życia modelu statystycznego jest znacznie dłuższy, ponieważ w trakcie korzystania z modelu może okazać się, że konieczne będzie dostosowanie jego parametrów w celu polepszenia jego jakości.

[źródło: Shearer, C. (2000) The CRISP-DM Model: The New Blueprint for Data Mining. Journal of Data Warehousing, 5, 13-22.]

Predictive a Preventive Maintenance

Dbanie o jakość i niezawodność świadczonych usług jest w dzisiejszych czasach jednym z najistotniejszych elementów, który pozwala na budowanie dobrego wizerunku w oczach klientów. Dostęp do dużych zbiorów danych pochodzących z sensorów maszyn produkcyjnych umożliwił nieustanne analizowanie stanu urządzeń w celu uniknięcia jakichkolwiek niespodziewanych awarii.

Wiele firm stosuje koncepcję znaną jako preventive maintenance. Polega ona na definiowaniu zużycia sprzętu na podstawie czasu jego amortyzacji. Prace konserwacyjne wykonywane są według określonego harmonogramu, który nie ma w żaden sposób związku z rzeczywistym stanem. Jest on jedynie rekomendacją wydaną na podstawie przeszłych awarii, doświadczeń. Utrzymywanie stanu technicznego infrastruktury według tej metody jest skuteczne, jednak z jedenj strony nie chroni wystarczająco dobrze przed niespodziewanymi awariami, a z drugiej - czasem wymaga przeprowadzania akcji serwisowych wynikających z harmonogramu mimo tego, że są one całkowicie zbędne.

Predictive maintenance jest calkowicie odmienną koncepcją, która bazując na danych pochodzących z sensorów urządzeń oraz modeli statystycznych, bądź algorytmów uczenia maszynowego, jest w stanie w czasie rzeczywistym zweryfikować stan urządzenia i ocenić jakie działania są potrzebne by uniknąć niespodziewanych awarii. Dane historyczne wykorzystywane są w celu odkrycia zależności, które pozwolą przewidzieć wszelkie niepożądane zdarzenia. Powstałe modele statystyczne są następnie implementowane w ramach tzw. silników reguł, które w zależności od założeń biznesowych, mogą działac w trybie real-time, micro-batch (umożliwiając analizę danych w czasie zbliżonym do rzeczywistego) lub w trybie wsadowym. Bardziej dynamiczne rozwiązania pozwalają na automatyczne odświeżanie modeli statystycznych według określonego interwału czasowego i natychmiastowe dostosowywanie parametrów silnika reguł tak, że proces uczenia się i wdrożenia nowonauczonego modelu są w pełni zautomatyzowane.

[źródło: Mobley R. K. (2002) An Introduction to Predictive Maintanance.

Predictive Maintanance w praktyce – przykładowa implementacja Za przykład systemu analizującego zdarzenia infrastruktury, posłuży zaimplementowany w tym roku system CEP (Complex Event Processing) dla jednego z operatorów telekomunikacyjnych oparty o klaster Big Data.

Do jego powstania przyczyniły się nastepujące potrzeby biznesowe:

[źródło: Shearer, C. (2000) The CRISP-DM Model: The New Blueprint for Data Mining. Journal of Data Warehousing, 5, 13-22.]

Predictive a Preventive Maintenance

Dbanie o jakość i niezawodność świadczonych usług jest w dzisiejszych czasach jednym z najistotniejszych elementów, który pozwala na budowanie dobrego wizerunku w oczach klientów. Dostęp do dużych zbiorów danych pochodzących z sensorów maszyn produkcyjnych umożliwił nieustanne analizowanie stanu urządzeń w celu uniknięcia jakichkolwiek niespodziewanych awarii.

Wiele firm stosuje koncepcję znaną jako preventive maintenance. Polega ona na definiowaniu zużycia sprzętu na podstawie czasu jego amortyzacji. Prace konserwacyjne wykonywane są według określonego harmonogramu, który nie ma w żaden sposób związku z rzeczywistym stanem. Jest on jedynie rekomendacją wydaną na podstawie przeszłych awarii, doświadczeń. Utrzymywanie stanu technicznego infrastruktury według tej metody jest skuteczne, jednak z jedenj strony nie chroni wystarczająco dobrze przed niespodziewanymi awariami, a z drugiej - czasem wymaga przeprowadzania akcji serwisowych wynikających z harmonogramu mimo tego, że są one całkowicie zbędne.

Predictive maintenance jest calkowicie odmienną koncepcją, która bazując na danych pochodzących z sensorów urządzeń oraz modeli statystycznych, bądź algorytmów uczenia maszynowego, jest w stanie w czasie rzeczywistym zweryfikować stan urządzenia i ocenić jakie działania są potrzebne by uniknąć niespodziewanych awarii. Dane historyczne wykorzystywane są w celu odkrycia zależności, które pozwolą przewidzieć wszelkie niepożądane zdarzenia. Powstałe modele statystyczne są następnie implementowane w ramach tzw. silników reguł, które w zależności od założeń biznesowych, mogą działac w trybie real-time, micro-batch (umożliwiając analizę danych w czasie zbliżonym do rzeczywistego) lub w trybie wsadowym. Bardziej dynamiczne rozwiązania pozwalają na automatyczne odświeżanie modeli statystycznych według określonego interwału czasowego i natychmiastowe dostosowywanie parametrów silnika reguł tak, że proces uczenia się i wdrożenia nowonauczonego modelu są w pełni zautomatyzowane.

[źródło: Mobley R. K. (2002) An Introduction to Predictive Maintanance.

Predictive Maintanance w praktyce – przykładowa implementacja Za przykład systemu analizującego zdarzenia infrastruktury, posłuży zaimplementowany w tym roku system CEP (Complex Event Processing) dla jednego z operatorów telekomunikacyjnych oparty o klaster Big Data.

Do jego powstania przyczyniły się nastepujące potrzeby biznesowe:

- Poprawa relacji z klientem podczas kontaktu z linią wsparcia.

- Przyśpieszenie procesu wykrywania i naprawy usterek infrastruktury opowiedzialnej za dostarczanie sygnału internetowego oraz telewizyjnego do klientów.

- Od technicznej strony, zostały postawione następujące wymagania:

Stworzenie rozwiązania CEP opartego o silnik reguł (Rules Engine). - Skalowalność rozwiązania ze względu na ilość reguł stosowanych dla każdego nadchodzącego zdażenia infrastruktury.

- Zdolność do przetwarzania danych tak szybko jak są one dostępne (w praktyce przetwarzanie wsadowe (batch) każde 15/60 minut dla ok. 80 Gb danych) .

- Oparcie o rozwiązania open-source dostępne na platformie Cloudera CDH.

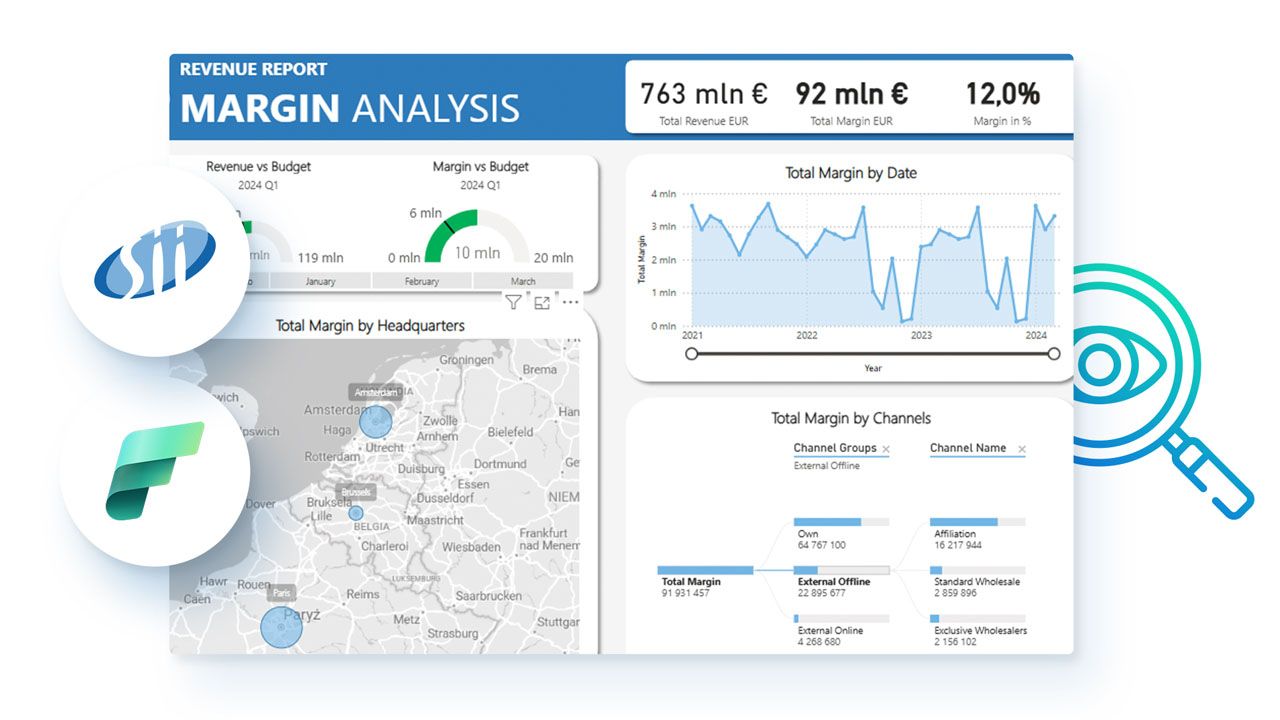

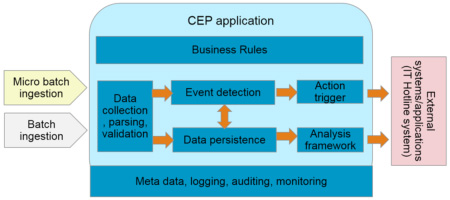

Zaimplementowany system CEP został przedstawiony na poniższej grafice:

Rysunek 1

Jego elementy można scharakteryzować następująco:

- Dane z elementów infrastruktury zostają załadowane z klastra HDFS (tabele Hive).

- Po ich walidacji odbywa się faza detekcji interesujących zdarzeń zgodnie z predefiniowanymi regułami biznesowymi.

- Historia analizy zostaje zapisana dla celów dalszego ulepszania i rozwijania reguł biznesowych, natomiast wyniki aktualne są udostępniane dla zainteresowanych systemów zewnętrznych, w tym wypadku systemu należącego do IT Hotline, a w przyszłości również do systemu działu odpowiedzialnego za usuwanie usterek infrastruktury.

- Pracownik IT Hotline po otrzymaniu zgłoszenia w ciągu kilku sekund otrzymuje informację o prawdopodobnej przyczynie usterki, o czym informuje kontaktującego się z nim klienta, po czym przysyła informacje dalej do działu infrastruktury.

Z technicznego punktu widzenia do implementacji zostały użyte następujące elementy zawarte na platformie Cloudera CDH:Hive/Impala, Spark, Solr, Oozie oraz serwis web oparty o Wildfly.

Aktualnie po udanym wdrożeniu na produkcję, następnym planowanym krokiem rozwoju systemu jest udoskonalenie go w taki sposób aby możliwe było proaktywne zgłaszanie miejsc występowania usterek i umożliwienie usunięcia ich zanim nastąpią w praktyce (np. wymiana karty sieciowej). W tym celu statyczne reguły biznesowe (matematyczne) zostana zastąpione przez algorytmy machine learning.

Auatorzy:

Dawid Benski – lat 34, Starszy Architekt działu Insights & Data w firmie Capgemini Software Solutions Center. we Wrocławiu. Posiada 7 lat doświadczenia w projektach bazodanowych i Business Intelligence oraz 3 lata doświadczenia w projektach Big Data.

Michał Dura – lat 25, Inżynier Oprogramowania w dziale Insights & Data w firmie Capgemini Software Solutions Center. we Wrocławiu. Posiada 2 lata doświadczenia w projektach Big Data.

Najnowsze wiadomości

Kwantowy przełom w cyberochronie - nadchodząca dekada przepisze zasady szyfrowania na nowo

Przez długi czas cyfrowe bezpieczeństwo opierało się na prostym założeniu: współczesne komputery potrzebowałyby ogromnych zasobów i wielu lat, aby złamać silne algorytmy szyfrowania. Rozwój technologii kwantowej zaczyna jednak tę regułę podważać, a eksperci przewidują, że w perspektywie 5–10 lat może nadejść „dzień zero”. Jest to moment, w którym zaawansowana maszyna kwantowa będzie w stanie przełamać większość aktualnie stosowanych zabezpieczeń kryptograficznych w czasie liczonym nie w latach, lecz w godzinach.

PSI prezentuje nową identyfikację wizualną

W ramach realizowanej strategii transformacji PSI Software SE zaprezentowała nową identyfikację wizualną. Odświeżony wizerunek w spójny sposób oddaje technologiczne zaawansowanie firmy, jej głęboką wiedzę branżową oraz silne ukierunkowanie na potrzeby klientów. Zmiany te wzmacniają pozycję PSI jako innowacyjnego lidera technologicznego w obszarze skalowalnych rozwiązań informatycznych opartych na sztucznej inteligencji i chmurze, rozwijanych z myślą o energetyce i przemyśle.

W ramach realizowanej strategii transformacji PSI Software SE zaprezentowała nową identyfikację wizualną. Odświeżony wizerunek w spójny sposób oddaje technologiczne zaawansowanie firmy, jej głęboką wiedzę branżową oraz silne ukierunkowanie na potrzeby klientów. Zmiany te wzmacniają pozycję PSI jako innowacyjnego lidera technologicznego w obszarze skalowalnych rozwiązań informatycznych opartych na sztucznej inteligencji i chmurze, rozwijanych z myślą o energetyce i przemyśle.

W ramach realizowanej strategii transformacji PSI Software SE zaprezentowała nową identyfikację wizualną. Odświeżony wizerunek w spójny sposób oddaje technologiczne zaawansowanie firmy, jej głęboką wiedzę branżową oraz silne ukierunkowanie na potrzeby klientów. Zmiany te wzmacniają pozycję PSI jako innowacyjnego lidera technologicznego w obszarze skalowalnych rozwiązań informatycznych opartych na sztucznej inteligencji i chmurze, rozwijanych z myślą o energetyce i przemyśle.

W ramach realizowanej strategii transformacji PSI Software SE zaprezentowała nową identyfikację wizualną. Odświeżony wizerunek w spójny sposób oddaje technologiczne zaawansowanie firmy, jej głęboką wiedzę branżową oraz silne ukierunkowanie na potrzeby klientów. Zmiany te wzmacniają pozycję PSI jako innowacyjnego lidera technologicznego w obszarze skalowalnych rozwiązań informatycznych opartych na sztucznej inteligencji i chmurze, rozwijanych z myślą o energetyce i przemyśle.

PROMAG S.A. rozpoczyna wdrożenie systemu ERP IFS Cloud we współpracy z L-Systems

PROMAG S.A., lider w obszarze intralogistyki, rozpoczął wdrożenie systemu ERP IFS Cloud, który ma wesprzeć dalszy rozwój firmy oraz integrację kluczowych procesów biznesowych. Projekt realizowany jest we współpracy z firmą L-Systems i obejmuje m.in. obszary finansów, produkcji, logistyki, projektów oraz serwisu, odpowiadając na rosnącą skalę i złożoność realizowanych przedsięwzięć.

F5 rozszerza portfolio bezpieczeństwa o narzędzia do ochrony systemów AI w środowiskach enterprise

F5 ogłosiło wprowadzenie dwóch nowych rozwiązań - F5 AI Guardrails oraz F5 AI Red Team - które mają odpowiedzieć na jedno z kluczowych wyzwań współczesnych organizacji: bezpieczne wdrażanie i eksploatację systemów sztucznej inteligencji na dużą skalę. Nowa oferta łączy ochronę działania modeli AI w czasie rzeczywistym z ofensy

Snowflake + OpenAI: AI bliżej biznesu

Snowflake przyspiesza wykorzystanie danych i sztucznej inteligencji w firmach, przenosząc AI z fazy eksperymentów do codziennych procesów biznesowych. Nowe rozwiązania w ramach AI Data Cloud integrują modele AI bezpośrednio z danymi, narzędziami deweloperskimi i warstwą semantyczną. Partnerstwo z OpenAI, agent Cortex Code, Semantic View Autopilot oraz rozwój Snowflake Postgres pokazują, jak budować skalowalne, bezpieczne i mierzalne wdrożenia AI w skali całej organizacji.

Najnowsze artykuły

Magazyn bez błędów? Sprawdź, jak system WMS zmienia codzienność logistyki

Współczesna logistyka wymaga nie tylko szybkości działania, lecz także maksymalnej precyzji – to właśnie te czynniki coraz częściej decydują o przewadze konkurencyjnej firm. Nawet drobne pomyłki w ewidencji stanów magazynowych, błędy przy przyjmowaniu dostaw czy nieprawidłowe rozmieszczenie towarów, mogą skutkować poważnymi stratami finansowymi i opóźnieniami w realizacji zamówień. W jaki sposób nowoczesne rozwiązania do zarządzania pomagają unikać takich sytuacji? Czym właściwie różni się tradycyjny system magazynowy od zaawansowanych rozwiązań klasy WMS (ang. Warehouse Management System)? I w jaki sposób inteligentne zarządzanie procesami magazynowymi realnie usprawnia codzienną pracę setek firm?

Współczesna logistyka wymaga nie tylko szybkości działania, lecz także maksymalnej precyzji – to właśnie te czynniki coraz częściej decydują o przewadze konkurencyjnej firm. Nawet drobne pomyłki w ewidencji stanów magazynowych, błędy przy przyjmowaniu dostaw czy nieprawidłowe rozmieszczenie towarów, mogą skutkować poważnymi stratami finansowymi i opóźnieniami w realizacji zamówień. W jaki sposób nowoczesne rozwiązania do zarządzania pomagają unikać takich sytuacji? Czym właściwie różni się tradycyjny system magazynowy od zaawansowanych rozwiązań klasy WMS (ang. Warehouse Management System)? I w jaki sposób inteligentne zarządzanie procesami magazynowymi realnie usprawnia codzienną pracę setek firm?

Migracja z SAP ECC na S4 HANA: Ryzyka, korzyści i alternatywne rozwiązania

W ostatnich latach wiele firm, które korzystają z systemu SAP ECC (Enterprise Central Component), stoi przed decyzją o przejściu na nowszą wersję — SAP S4 HANA. W obliczu końca wsparcia dla ECC w 2030 roku, temat ten staje się coraz bardziej aktualny. Przemiany technologiczne oraz rosnące oczekiwania związane z integracją nowych funkcji, jak sztuczna inteligencja (AI), skłaniają do refleksji nad tym, czy warto podjąć tak dużą zmianę w architekturze systemu. Przyjrzyjmy się głównym powodom, dla których firmy rozważają migrację do S4 HANA, ale także argumentom, które mogą przemawiać za pozostaniem przy dotychczasowym systemie ECC, przynajmniej na krótki okres.

Jak maksymalizować zyski z MTO i MTS dzięki BPSC ERP?

Zysk przedsiębiorstwa produkcyjnego zależy nie tylko od wydajności maszyn, ale przede wszystkim od precyzyjnego planowania, realnych danych i umiejętnego zarządzania procesami. Dlatego firmy, które chcą skutecznie działać zarówno w modelu Make to Stock (MTS), jak i Make to Order (MTO), coraz częściej sięgają po rozwiązania klasy ERP, takie jak BPSC ERP.

Zysk przedsiębiorstwa produkcyjnego zależy nie tylko od wydajności maszyn, ale przede wszystkim od precyzyjnego planowania, realnych danych i umiejętnego zarządzania procesami. Dlatego firmy, które chcą skutecznie działać zarówno w modelu Make to Stock (MTS), jak i Make to Order (MTO), coraz częściej sięgają po rozwiązania klasy ERP, takie jak BPSC ERP.

Ponad połowa cyberataków zaczyna się od błędu człowieka

Ponad 2/3 firm w Polsce odnotowała w zeszłym roku co najmniej 1 incydent naruszenia bezpieczeństwa . Według danych Unit 42, zespołu analitycznego Palo Alto Networks, aż 60% ataków rozpoczyna się od działań wymierzonych w pracowników – najczęściej pod postacią phishingu i innych form inżynierii społecznej . To pokazuje, że w systemie ochrony organizacji pracownicy są kluczowym ogniwem – i że firmy muszą nie tylko edukować, ale też konsekwentnie egzekwować zasady cyberhigieny. Warto o tym pamiętać szczególnie teraz, w październiku, gdy obchodzimy Europejski Miesiąc Cyberbezpieczeństwa.

MES - holistyczne zarządzanie produkcją

Nowoczesna produkcja wymaga precyzji, szybkości i pełnej kontroli nad przebiegiem procesów. Rosnąca złożoność zleceń oraz presja kosztowa sprawiają, że ręczne raportowanie i intuicyjne zarządzanie coraz częściej okazują się niewystarczające. Firmy szukają rozwiązań, które umożliwiają im widzenie produkcji „na żywo”, a nie z opóźnieniem kilku godzin czy dni. W tym kontekście kluczową rolę odgrywają narzędzia, które porządkują informacje i pozwalają reagować natychmiast, zamiast po fakcie.

Przeczytaj Również

Real-Time Intelligence – od trendu do biznesowego must-have

Sposób prowadzenia działalności gospodarczej dynamicznie się zmienia. Firmy muszą stale dostosowywa… / Czytaj więcej

EPM – co to jest? Czy jest alternatywą dla BI?

Nowoczesne systemy BI i EPM dostarczają wiedzy potrzebnej do efektywnego zarządzania firmą. Czy zna… / Czytaj więcej

W jaki sposób firmy zwiększają swoją odporność na zmiany?

Do zwiększenia odporności na zmiany, konieczna jest pełna kontrola nad codziennymi procesami zapewn… / Czytaj więcej

Dlaczego systemy kontrolingowe są potrzebne współczesnym firmom?

Narzędzia Corporate Performance Management (CPM) pozwalają na przyśpieszenie tempa podejmowania dec… / Czytaj więcej

Hurtownie danych – funkcje i znaczenie dla BI

Przepisów na sukces biznesu jest na rynku wiele. Nie ulega jednak wątpliwości, że jednym z kluczowy… / Czytaj więcej

Po co dane w handlu? Okazuje się, że ich analityka może dać nawet 30 proc. większe zyski!

Jak wynika z badania firmy doradczej Capgemni, producenci FMCG oraz firmy związane z handlem detali… / Czytaj więcej